Kas yra robots.txt – Kaip jį paruošti?

Robots.txt failas yra vienas svarbiausių, bet dažnai nepelnytai pamirštų techninės SEO optimizacijos įrankių. Šis nedidelis tekstinis dokumentas turi milžinišką įtaką tam, kaip paieškos sistemų robotai sąveikauja su jūsų svetaine – ką jie gali matyti ir ko ne. Teisingas robots.txt konfigūravimas gali padėti efektyviau valdyti indeksavimo procesą, apsaugoti privačias svetainės dalis ir optimizuoti paieškos robotų išteklių naudojimą.

Šiame straipsnyje sužinosite, kas tiksliai yra robots.txt failas, kaip jis veikia, kaip teisingai sukurti ir konfigūruoti šį failą, kokių klaidų vengti ir kaip išnaudoti visas jo galimybes savo svetainės SEO optimizacijai.

Kas yra robots.txt ir kaip jis veikia?

Robots.txt yra paprastas tekstinis failas, kuris patalpintas svetainės šakniniame (root) kataloge. Jo pagrindinis tikslas – pateikti nurodymus paieškos sistemų robotams (dar vadinamiems botas ar crawleriais), kurie lankosi jūsų svetainėje.

Šis failas – tai tarsi instrukcija ar taisyklių rinkinys, nurodantis paieškos sistemoms, kokias svetainės dalis jos gali analizuoti, o kokių ne.

Kiekvieną kartą, kai paieškos sistemos robotas, pavyzdžiui, Googlebot ar Bingbot, aplanko jūsų svetainę, pirmiausia jis ieško robots.txt failo adresu www.jususvetaine.lt/robots.txt. Jei šį failą randa, robotas perskaito jame esančius nurodymus ir tuomet atitinkamai elgiasi tyrinėdamas jūsų svetainę.

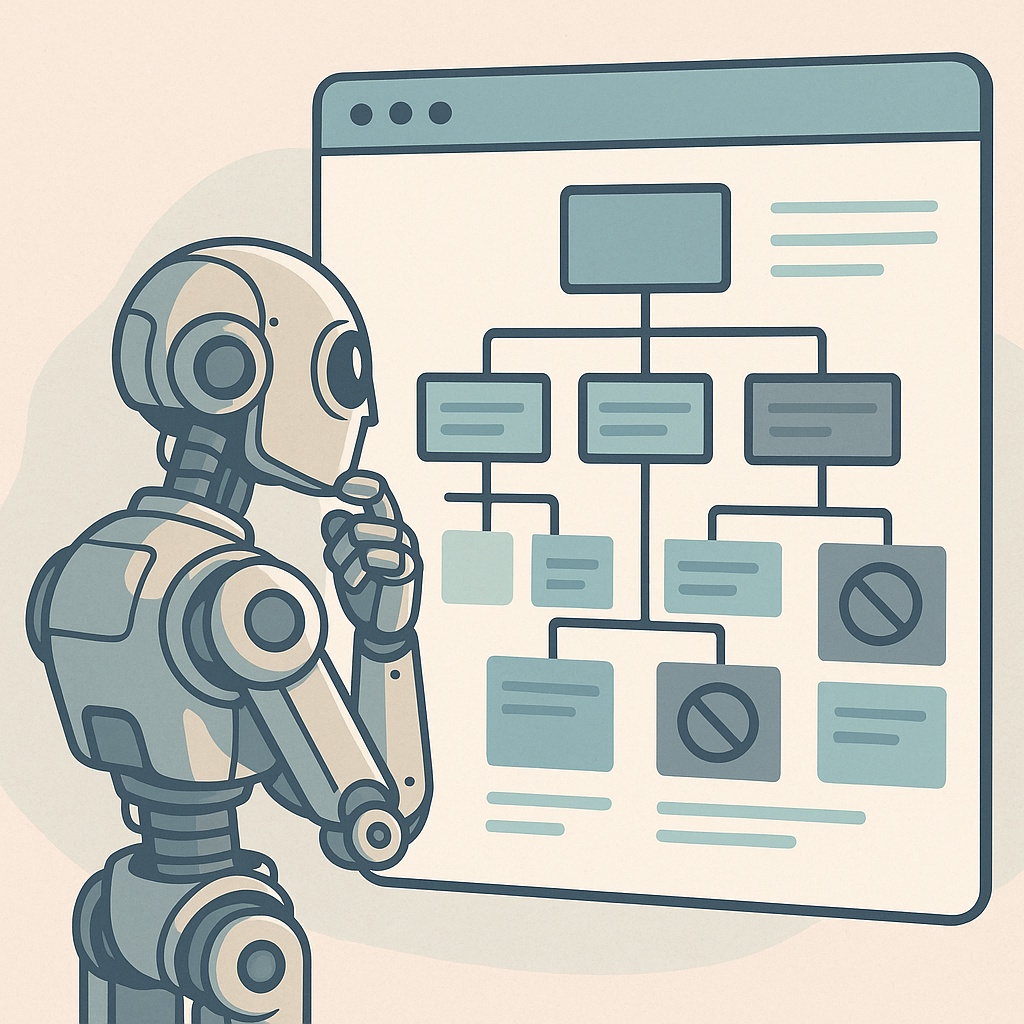

Svarbu suprasti, kad robots.txt daro įtaką tik svetainės naršymui (crawling), o ne indeksavimui (indexing). Tai reiškia, kad net jei uždrausite robotui aplankyti tam tikrą puslapį per robots.txt, jei tas puslapis turi nuorodų iš kitų svetainių, jis vis tiek gali būti įtrauktas į paieškos sistemų indeksą. Norint visiškai uždrausti puslapio indeksavimą, reikia naudoti kitus metodus, pvz., meta robots žymą su „noindex” nurodymu.

Taip pat verta paminėti, kad robots.txt taisyklių laikosi tik „mandagūs” botai – tokie kaip pagrindinių paieškos sistemų robotai. Kenkėjiški botai ar spamerių įrankiai dažnai ignoruoja šį failą ir vis tiek bandys pasiekti visas jūsų svetainės dalis.

Robots.txt sintaksė: User-Agent, Disallow ir Allow paaiškinimas

Norint teisingai sukonfigūruoti robots.txt failą, būtina suprasti jo pagrindinę sintaksę. Robots.txt yra sudarytas iš kelių pagrindinių direktyvų, kurios nurodo, kokie robotai ir kokių svetainės dalių negali pasiekti arba gali pasiekti.

Štai pagrindinės robots.txt direktyvos:

- User-agent: nurodo, kuriam robotui taikoma taisyklė. Žvaigždutė (*) reiškia visus robotus.

- Disallow: nurodo, kokius katalogus ar puslapius robotai negali lankyti.

- Allow: nurodo išimtis Disallow taisyklėms – t.y., kokius katalogus ar puslapius robotai gali lankyti, net jei jie yra uždraustame kataloge.

- Sitemap: nurodo, kur yra jūsų svetainės sitemap.xml failas.

Štai paprasčiausias robots.txt failo pavyzdys:

User-agent: * Disallow: /admin/ Disallow: /private/ Allow: /private/public-file.html Sitemap: https://www.jususvetaine.lt/sitemap.xml

Šis pavyzdys reiškia:

- Taisyklės taikomos visiems robotams (User-agent: *)

- Robotai negali naršyti /admin/ ir /private/ katalogų

- Tačiau jiems leidžiama naršyti failą /private/public-file.html

- Nurodoma, kad svetainės sitemap.xml failas yra nurodytu adresu

Galite naudoti įvairias specialias sintaksės taisykles taisyklių kūrimui:

- Žvaigždutė (*): Naudojama kaip pakaitos simbolis. Pavyzdžiui, „Disallow: /*.pdf” užblokuos visus PDF failus.

- Dolerio ženklas ($): Nurodo URL pabaigą. Pavyzdžiui, „Disallow: /*.php$” užblokuos visus PHP failus.

Taip pat galite kurti atskiras taisykles konkretiems robotams:

User-agent: Googlebot Disallow: /ne-google/ User-agent: Bingbot Disallow: /ne-bing/ User-agent: * Disallow: /private/

Atkreipkite dėmesį, kad kai kurios direktyvos, kaip „Crawl-delay”, yra palaikomos tik tam tikrų paieškos sistemų (Google jos nepalaiko), todėl visada rekomenduojama peržiūrėti konkrečios paieškos sistemos dokumentaciją.

Kaip sukurti ir patikrinti robots.txt failą

Robots.txt failo sukūrimas yra gana paprastas procesas, tačiau reikia atidžiai laikytis tam tikrų taisyklių, kad jis būtų efektyvus ir nesukeltų nenumatytų problemų. Štai žingsniai, kaip sukurti ir patikrinti robots.txt failą:

1. Sukurkite tekstinį failą

Naudodami bet kokį tekstinį redaktorių (pvz., Notepad, TextEdit ar VS Code), sukurkite paprastą tekstinį failą ir išsaugokite jį pavadinimu „robots.txt”.

2. Įrašykite taisykles

Pagal ankstesniame skyriuje aptartas taisykles, įrašykite reikiamas direktyvas. Pradėkite nuo bazinio robots.txt šablono:

User-agent: * Disallow: Sitemap: https://www.jususvetaine.lt/sitemap.xml

Šis pavyzdys leidžia visiems robotams naršyti visą svetainę ir nurodo sitemap vietą.

3. Įkelkite failą į teisingą vietą

Robots.txt failas privalo būti patalpintas jūsų svetainės šakniniame kataloge, t.y. adresu:

https://www.jususvetaine.lt/robots.txt

Atkreipkite dėmesį, kad:

- Failas turi būti tiksliai pavadintas „robots.txt” (mažosiomis raidėmis)

- Kiekvienam subdomenui reikia atskiro robots.txt failo (pvz., blog.jususvetaine.lt turėtų turėti savo robots.txt)

- HTTP ir HTTPS protokolams taip pat reikalingi atskiri robots.txt failai, jei jūsų svetainė palaiko abu protokolus

4. Patikrinkite ir validuokite

Prieš įkeldami galutinį robots.txt, būtinai patikrinkite, ar jame nėra klaidų. Tam galite naudoti šiuos įrankius:

- Google Search Console – turi robots.txt testavimo įrankį

- Bing Webmaster Tools – taip pat leidžia testuoti robots.txt

- Įvairūs internete prieinami robots.txt validatoriai

Patikrinimo metu įsitikinkite, kad:

- Failas yra pasiekiamas (negrąžina 404 klaidos)

- Taisyklės veikia taip, kaip tikėtasi

- Netyčia neužblokavote svarbių puslapių ar failų

5. Stebėkite rezultatus

Įkėlę robots.txt, reguliariai tikrinkite Google Search Console serverio atsakymų skiltį, kad įsitikintumėte, jog paieškos sistemos robotai tinkamai seka jūsų nurodymus. Stebėkite indeksavimo statistiką ir atkreipkite dėmesį į galimus pokyčius po robots.txt modifikavimo.

Pagal naujas Google gaires, robots.txt failas turėtų būti pasiekiamas ir neturėtų grąžinti 4xx ar 5xx klaidų. Jei robots.txt failo nėra arba jis nepasiekiamas, Google interpretuoja tai kaip leidimą indeksuoti visą svetainę.

Geriausi robots.txt naudojimo būdai ir dažniausios klaidos

Teisingas robots.txt failo konfigūravimas gali turėti didelės įtakos jūsų svetainės SEO rezultatams. Štai keletas geriausių praktikų ir dažnai daromų klaidų, kurių reikėtų vengti.

Geriausi robots.txt naudojimo būdai

- Visada nurodykite sitemap: Įtraukite sitemap nuorodą į robots.txt failą, kad paieškos sistemoms būtų lengviau rasti ir indeksuoti jūsų turinį:

Sitemap: https://www.jususvetaine.lt/sitemap.xml

- Blokuokite nereikalingas sritis: Užblokuokite administracinių sričių, vidinių paieškos rezultatų puslapių ar kitų nereikšmingų svetainės dalių naršymą, kad taupytumėte crawl biudžetą:

-

Disallow: /admin/ Disallow: /search/ Disallow: /tmp/

- Blokuokite dublikiuotą turinį: Užblokuokite puslapius, kurie gali sukurti turinio dubliavimą, pavyzdžiui, filtravimo ar rūšiavimo parametrus:

Disallow: /*?sort= Disallow: /*?filter=

- Naudokite atskiras taisykles skirtingiems robotams: Jei reikia, sukurkite skirtingas taisykles įvairiems paieškos robotams:

User-agent: Googlebot-Image Disallow: /privatūs-paveikslėliai/

- Reguliariai atnaujinkite: Peržiūrėkite ir atnaujinkite robots.txt kiekvieną kartą, kai svetainės struktūra pasikeičia.

Dažniausios robots.txt klaidos

- Visiško blokavimo klaida: Viena pavojingiausių klaidų yra netyčia užblokuoti visą svetainę:

User-agent: * Disallow: /

Ši taisyklė užblokuos visų puslapių naršymą.

- Svarbaus turinio blokavimas: Netyčinis svarbių puslapių blokavimas gali smarkiai pakenkti SEO rezultatams.

- Neteisingai suprasta sintaksė: Dažnai klaidingai suprantama, kad „Disallow:” (be jokio kelio po dvitaškio) reiškia „draudžiama viskas”, tačiau iš tiesų tai reiškia „nėra jokių apribojimų”.

- Klaidingas naudojimas apsaugai: Robots.txt nesuteikia saugumo – jis tik pateikia rekomendacijas geriems robotams. Konfidencialiam turiniui reikia tikros apsaugos (slaptažodžių, prieigos kontrolės).

- Neteisingas failo pavadinimas ar vieta: Jei failas pavadintas „robot.txt”, „Robots.txt” ar patalpintas ne šakniniame kataloge, jis nebus rastas.

- Per daug pasikliovimas robots.txt: Norint uždrausti puslapį indeksuoti, geriau naudoti meta robots žymą su „noindex” nurodymu, o ne robots.txt.

Svarbu suprasti robots.txt ir meta robots žymų skirtumus. Robots.txt nurodo robotams, kurių puslapių jie negali naršyti, o meta robots žymos nurodo, kuriuos puslapius jie negali indeksuoti. Jei puslapis yra užblokuotas per robots.txt, bet turi nuorodų iš kitų svetainių, jis vis tiek gali būti indeksuojamas (nors ir be detalaus turinio analizės).

Optimalus variantas dažnai yra kombinuoti robots.txt ir meta robots žymas strategiškai pagal jūsų SEO optimizacijos tikslus.

Dažniausiai užduodami klausimai apie robots.txt

Kas nutiks, jei mano svetainė neturi robots.txt failo?

Jei jūsų svetainė neturi robots.txt failo, tai nebus laikoma klaida. Tiesiog paieškos sistemų robotai galės naršyti visas prieinamas svetainės dalis be apribojimų. Jei svetainėje nėra konfidencialaus turinio ar techninių puslapių, kuriuos norėtumėte apsaugoti nuo indeksavimo, tuomet robots.txt gali būti nebūtinas.

Ar robots.txt blokuoja visas paieškos sistemas?

Ne, robots.txt taisyklių laikosi tik „mandagūs” robotai, tokie kaip pagrindinių paieškos sistemų robotai (Googlebot, Bingbot). Kenkėjiški botai, spameriai ar duomenų vagystės įrankiai dažnai ignoruoja šias taisykles. Todėl konfidencialiam turiniui apsaugoti reikia naudoti papildomas apsaugos priemones.

Ar galiu naudoti robots.txt, kad pašalinčiau puslapius iš Google indekso?

Ne, robots.txt negali pašalinti jau indeksuotų puslapių. Jis tik neleidžia robotams naršyti nurodytų puslapių ateityje, bet jau indeksuoti puslapiai liks indekse. Norint pašalinti puslapį iš indekso, geriausia naudoti meta robots žymą su „noindex” nurodymu arba Google Search Console įrankį URL pašalinimui.

Kaip galiu patikrinti, ar mano robots.txt veikia teisingai?

Galite naudoti Google Search Console robots.txt testavimo įrankį, Bing Webmaster Tools arba specializuotus interneto validatorius. Šie įrankiai leis jums simuliuoti, kaip įvairūs paieškos robotai interpretuos jūsų robots.txt taisykles, ir pamatyti, ar jie galės pasiekti norimus URL.

Ką reiškia „User-agent: *”?

Žvaigždutė (*) po „User-agent:” nurodymo reiškia, kad taisyklės taikomos visiems paieškos robotams. Tai universalus nurodymas, apimantis visus botus, kurie laikosi robots.txt taisyklių. Jei norite taikyti taisykles tik konkrečiam botui, turite nurodyti jo pavadinimą, pvz., „User-agent: Googlebot”.

Jei domina mūsų paslaugos ar reikalinga konsultacija, skambinkite mums arba rašykite el. paštu.

naujienos ir straipsniai

Naujausi įrašai iš tinklaraščio

Kas yra GEO ir kuo jis skiriasi nuo SEO? Praktinis gidas verslui nuo Artix.lt komandos

Jei prieš kelerius metus daugumai verslų pakako galvoti apie Google pozicijas, šiandien [...]

Svetainės metrikos 2026: Kaip duomenų analizė padeda auginti verslą ir konversijas?

Dauguma verslo savininkų į analitikos įrankius užsuka tik tam, kad pamatytų bendrą [...]

Kontekstinė ir tikslinė reklama: išsamus skirtumų, strategijų ir konversijų optimizavimo gidas verslui

Šiuolaikinis interneto marketingas yra ne kas kita, kaip nuolatinė kova dėl vartotojo [...]

Google Ads (reklama) vs SEO: Kas geriau jūsų verslui 2026 metais?

Šiuolaikiniame skaitmeniniame pasaulyje verslo matomumas internete tapo ne prabanga, o būtinybe. Du [...]